카메라 없이 안구 움직임, 표정 인식하는 기술 개발돼

"눈알 굴리는 소리 들린다"라는 이야기를 한 번쯤은 들어봤을 것이다. 주로 선생님들이 딴 짓하는 학생들이나 부정 행위를 하는 이들에게 던지는 경고의 메시지다. 으름장을 놓는 의미이지, 눈알 굴리는 소리를 듣기란 사실상 불가능에 가깝다. 그런데 실제 눈알 굴리는 소리로 눈의 움직임을 추적하는 기술이 개발돼 눈길을 끈다.

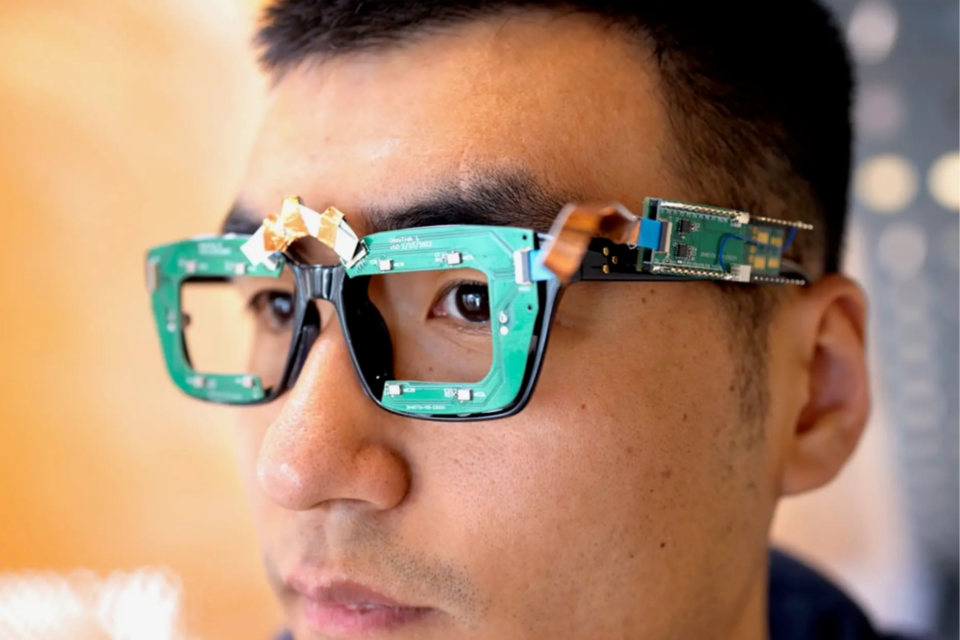

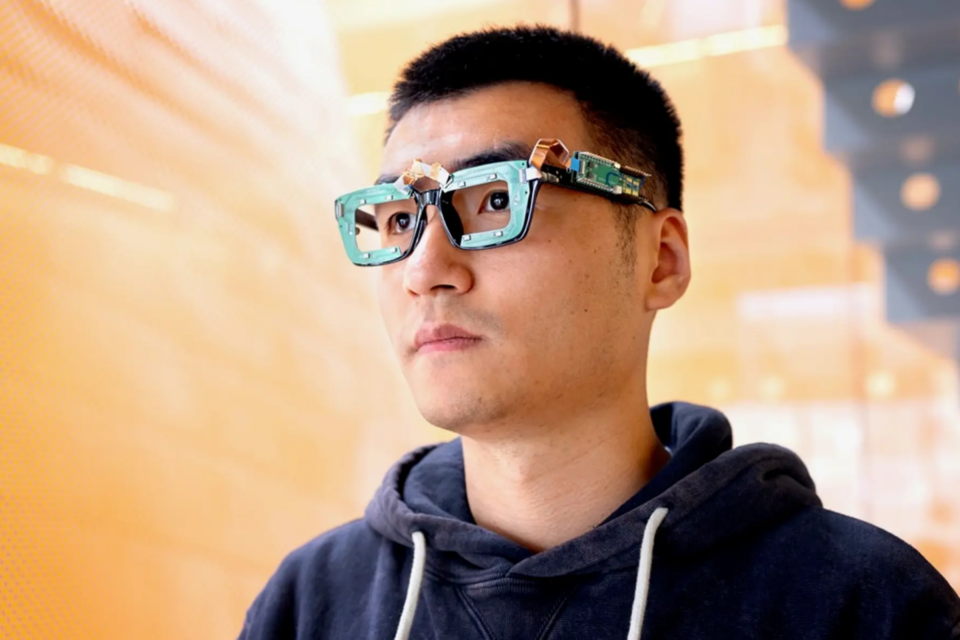

미국 코넬대학교 연구진은 사람의 시선과 얼굴 표정을 추적하는 기술 게이즈트랙(GazeTrak)과 '아이에코(EyeEcho)'를 개발했다고 10일(현지시간) 밝혔다. 두 가지 기술 모두 스마트글래스나 VR 헤드셋에 적용될 수 있고, 카메라 기반 시스템보다 훨씬 적은 전력을 필요로 한다. 몇 가지 특정 표정만 구별하는 기존 제품과 달리 지속적으로 표정을 추적할 수 있다는 게 특징이다.

카메라 없이 시선 및 표정을 추적할 수 있기 때문에 사용자 얼굴과 관련된 데이터도 수집하지 않는다. 개인정보 유출 우려가 없다는 이야기다. 먼저 게이즈트랙 기술은 안경 각 프레임 내부에 배열된 스피커 1개와 마이크 4개로 작동한다. 스피커는 들리지 않는 펄스 음파를 방출하며, 이 음파는 안구에 반사돼 마이크로 수집된다.

안구는 완벽하게 둥근 형태는 아니기 때문에 어느 쪽을 향하고 있는지에 따라 각 마이크에 도달하는 시간이 다르다. 이 기술은 소리를 감지하는데 있어 배경 소음에 방해를 받지 않는다고 한다. 카메라 기반 안구 추적 웨어러블만큼 정확하지 않을 수는 있지만, 전력 소비량이 5%에 불구해 VR 헤드셋에 탑재했을 경우 전력 효율에 큰 도움이 될 수 있다.

아이에코도 게이즈트랙과 같이 음파를 보내고 에코를 수신하는 방식이다. 안경에 탑재된 스피커와 마이크를 통해 작동하는데, 피부의 미묘한 움직임을 소리로 인식한다. 펄스가 방출되고 에코가 감지되는 사이의 경과 시간을 인공지능(AI) 소프트웨어로 분석해 특정 얼굴 표정과 일치시킨다.

자체 실험 결과 12명의 피험자들은 각각의 얼굴에 대해 단 4분간 훈련을 실시했고, 해당 시스템은 그들이 다양한 환경에서 일상 활동을 수행하는 경우에도 그들의 표정을 매우 정확하게 읽는 것으로 입증됐다. 연구를 주도한 박사과정생 'Ke Li'와 연구진은 "비전프로나 오큘러스와 같은 카메라 기반 시스템이 많다. 그러나 모든 사람들이 카메라로 사용자의 주변 환경을 비추는 것을 원하지 않는다"라고 밝혔다.

AI포스트(AIPOST) 유진 기자 aipostkorea@naver.com