메타, 허위 정보 확산 예방·투명성 확보 나서

"다른 플랫폼에서 만든 사진도 잡아낼 것"

몇 달 내로 자사 서비스에 기능 탑재 예정

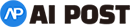

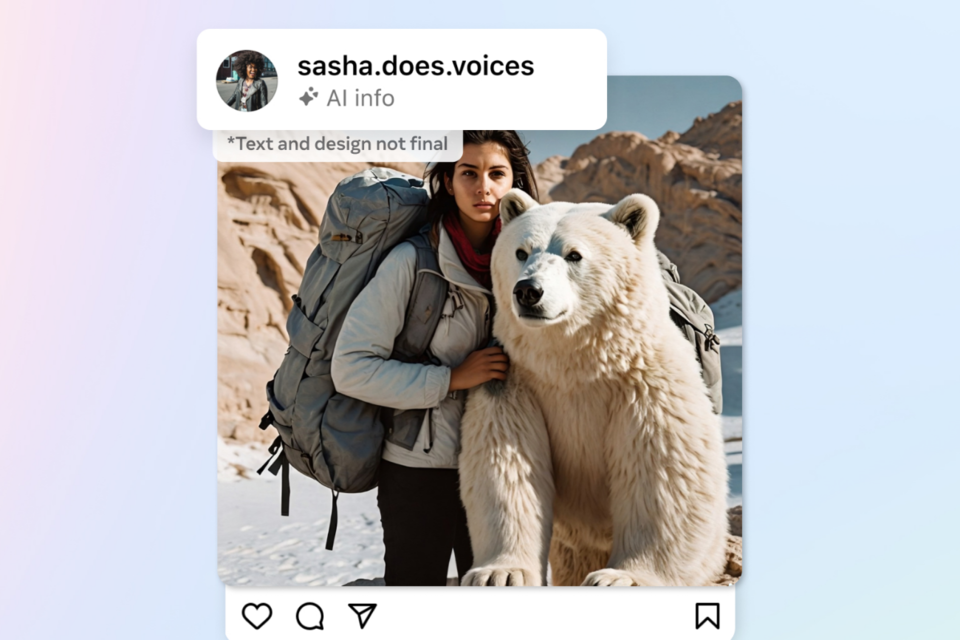

생성형 인공지능(AI)이 만든 사진과 실제 사진의 경계가 모호해지며, 허위 정보가 무분별하게 생산되고 확산될 우려도 커지고 있다. 이에 메타 플랫폼(META)이 페이스북과 인스타그램, 스레드 상에서 인공지능이 만든 사진이나 이미지를 식별할 수 있도록 워터마크(라벨)를 탑재하기로 했다.

6일(현지시간) 메타 뉴스룸에 따르면 메타플랫폼의 최고정책 책임자로 국제부문사장인 닉 클레그(Nick Clegg)는 "현재 메타 AI 기능을 사용해 생성된 이미지에는 'Imagined with AI'라는 라벨이 적용되고 있다"라며 "다른 회사의 도구로 생성된 콘텐츠에도 이 작업을 수행할 수 있도록 노력 중이다"라고 밝혔다.

닉 클레그는 이를 위해 관련 기업들과 협력해 공통 기술 표준을 조정해 왔다고 전했다. 이어 실제 사진과 유사한 이미지가 디지털 합성물임을 사용자에게 알리기 위해 몇 달내로 페이스북, 인스타그램, 스레드 서비스 내에서 AI로 생성된 콘텐츠에 라벨을 붙이는 기능을 탑재할 것이라고 밝혔다.

닉 클레그의 설명처럼 메타는 이미 자체 도구로 만든 콘텐츠에 라벨을 붙이고 있다. 이는 메타가 생성형 AI 기능을 구축하며 이행했던 책임감 있는 접근 방식의 중요한 부분이었다. 여기에다 마이크로소프트, 오픈AI 등 타사 기업들의 플랫폼을 활용해 만든 AI 콘텐츠에도 라벨을 붙이겠다는 것이 메타 측의 이야기다.

소셜미디어를 통해 유통된 콘텐츠가 인터넷 전반에 걸쳐 확산되기 때문에 이를 식별하기 위한 공통 표준 개발이 필요하다는 취지에서 비롯됐다. 하지만 현재 AI가 생성한 모든 콘텐츠를 식별하는 것은 불가능하며, AI 생성 콘텐츠의 보이지 않는 마커를 제거할 우려도 있다고 한다.

이에 메타는 다양한 옵션을 개발해, 기술적으로 마커를 제거하더라도 AI 콘텐츠를 감지하는 수준까지 끌어올리겠다는 구상이다. 닉 클레그는 "메타의 AI 연구소는 최근 'Stable Signature'라는 눈에 보이지 않는 워터마킹 기술에 대한 연구를 공유했다"라며 "이는 일부 유형의 이미지 생성기의 이미지 생성 프로세스에 워터마킹 메커니즘을 직접 통합한다. 이는 워터마킹을 비활성화할 수 없도록 오픈 소스 모델에 유용할 수 있다"라고 했다.

한편 최근 들어 AI 생성 이미지로 인한 피해 사례가 속출하고 있다. AI 콘텐츠로 이용자들을 속이려는 사람들과 이를 탐지하려는 이들의 움직임이 더욱 활발해질 것으로 예상된다.

AI포스트(AIPOST) 유진 기자 aipostkorea@naver.com