미국 앨런인공지능연구소(Ai2)가 새로운 오픈소스 모델인 '툴루(Tülu) 3'를 공개했다. Ai2는 자사의 모델이 딥시크 V3 모델보다 뛰어난 성능을 보유했다고 소개했다.

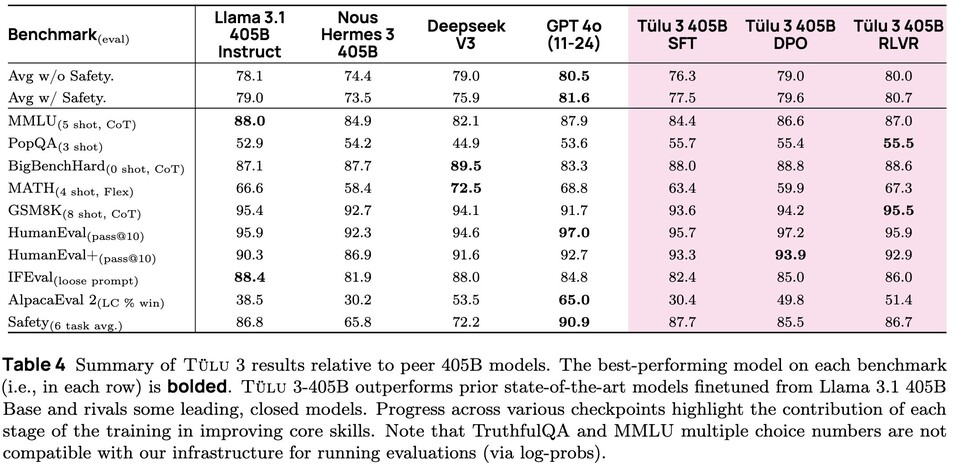

Ai2는 최근 4050억 개의 매개변수로 구성된 오픈소스 LLM '툴루 3 405B를 출시했다. Ai2는 공식 엑스를 통해 "툴루 3 제품군의 마지막 모델은 GPT-4o와 동등한 성능을 발휘하며, 라마 3.1 등 모델들을 능가한다"라고 밝혔다.

툴루 3 405B 모델은 검증 가능한 보상을 통한 강화학습(RLVR) 기법으로 사후훈련에 초점을 맞췄다. 데이터셋과 코드를 제공하는 등 제대로 된 '오픈소스'를 표방하고 있다.

기존 오픈소스 모델과 다른 점은 검증 가능한 결과를 활용해 모델의 성능을 미세 조정한다는 점이다. 이에 안전성을 유지하면서 높은 정확도로 추론이 가능하게 됐다.

툴루 3 405B 모델은 안전성 벤치마크에서 딥시크 V3, 누스의 헤르메스 3 등을 뛰어넘었다. Ai2 측은 "전반적으로, 우리의 결과는 딥시크 V3보다 일관된 우위를 보여줬다. 특히 안전 벤치마크에서 그렇다"라고 밝혔다.

한편 딥시크 V3는 6710억개의 매개변수를 보유하고 있는 오픈소스 모델이다. 4050억개의 매개변수를 가진 라마 3.1의 1.5배에 달하는 규모다. 오픈소스로 제공되는 모델 가운데 가장 큰 규모다. 데이터셋도 방대하다.

딥시크 V3는 14조 8000억개의 토큰으로 구성된 데이터셋으로 사전 훈련됐다고 한다. 딥시크는 대형 기술 회사에서 개발한 모델보다 훨씬 적은 컴퓨팅 리소스를 사용했다고 밝혀 업계에 주목을 받았다.

AI포스트(AIPOST) 유진 기자 aipostkorea@naver.com